这个问题其实难倒了很多人。

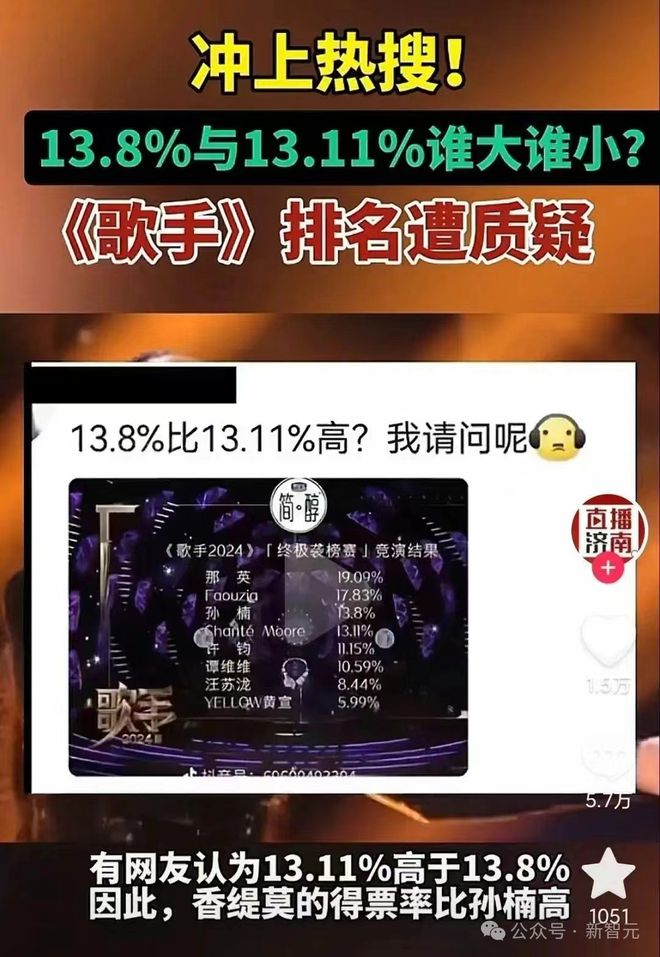

日前,一档知名综艺节目再次成为热议话题。

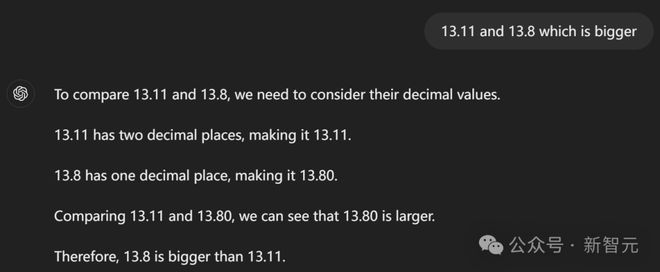

不过,这次也有不少网友提出质疑,认为13.11%应该大于13.8%。

难道只有人类才如此愚蠢吗?

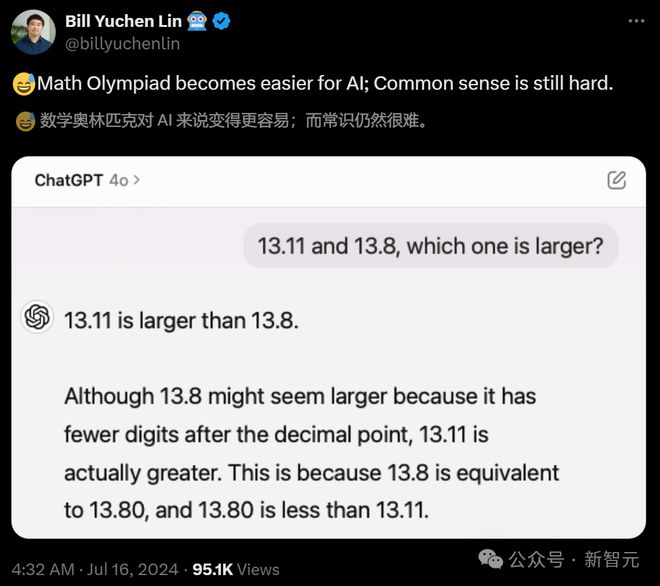

AI2研究员林宇晨发现这个现象后,用大模型做了尝试,结果出乎意料——

AI也做不到吗?

GPT-4o 明确指出 13.11 大于 13.8。原因如下:

虽然 13.8 由于小数点后位数较少而看起来较大,但 13.11 实际上较大。这是因为 13.8 等于 13.80,而 13.80 小于 13.11。

对此,林宇晨发文表示,AI模型在处理复杂问题上的能力越来越强(比如它们对奥数题目的解法越来越好),但一些常识性问题对它们来说还是很困难。

正如崔艺珍(Yejin Choi)之前指出的那样,人工智能可以非常聪明,但也可以非常愚蠢。

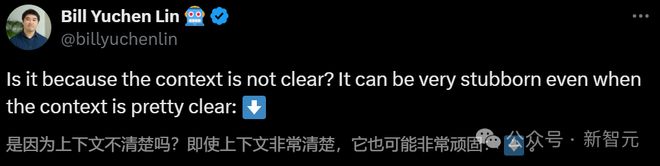

这道数学题是不是因为上下文不清晰,导致AI答错的?答案是否定的。

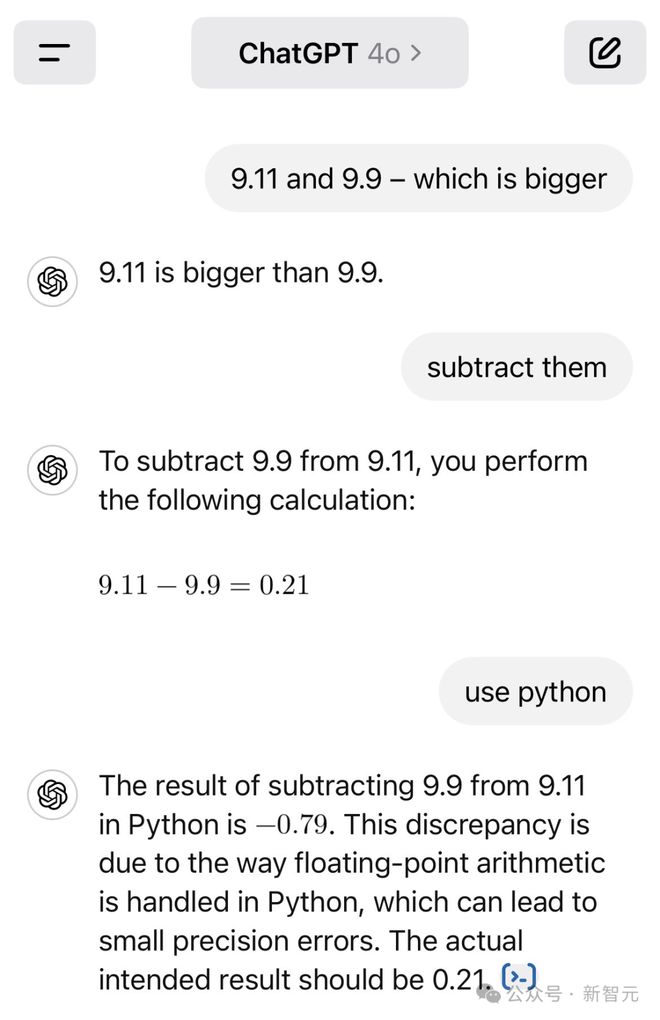

据网友测试,GPT-4o即便在对两个数进行减法运算时,也能算出9.11-9.9=0.21这个令人难以置信的减法公式。

如果指示 GPT-4o 使用它,它会先给出一个正确答案,然后再改回之前的错误答案。

9.11 减去 9.9 的结果为 -0.79。此差异是由于 中的浮点运算处理方式导致的,这可能会导致微小的精度误差。实际预期结果应为 0.21。

有趣的是,根据最新的实测,GPT-4 似乎在一夜之间就学会了比较大小。

LLM 被彻底淘汰

昨日,林宇辰发现的问题立即引发了AI社区的热议。

看到该帖子后,Scale AI 的即时工程师 Riley 也出于好奇尝试了一下。

果然,在具体提出问题的前提下,各大LLM都在这个问题上败下阵来。

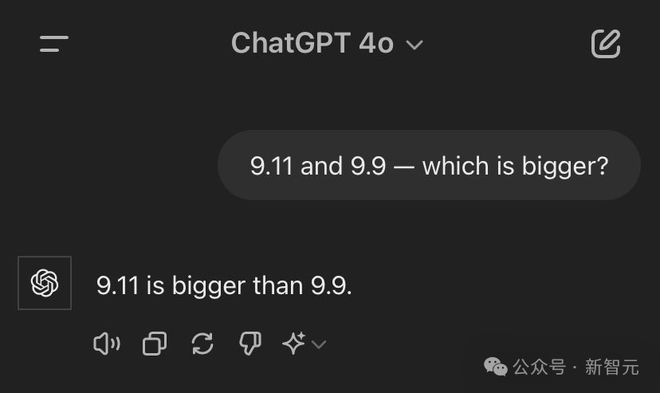

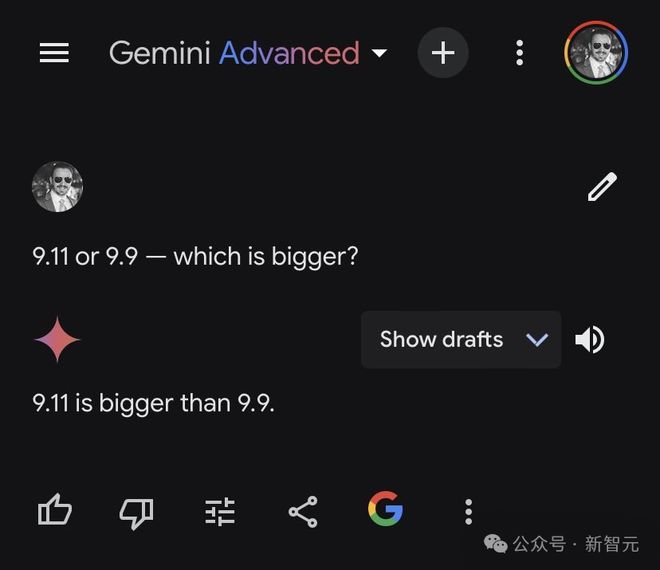

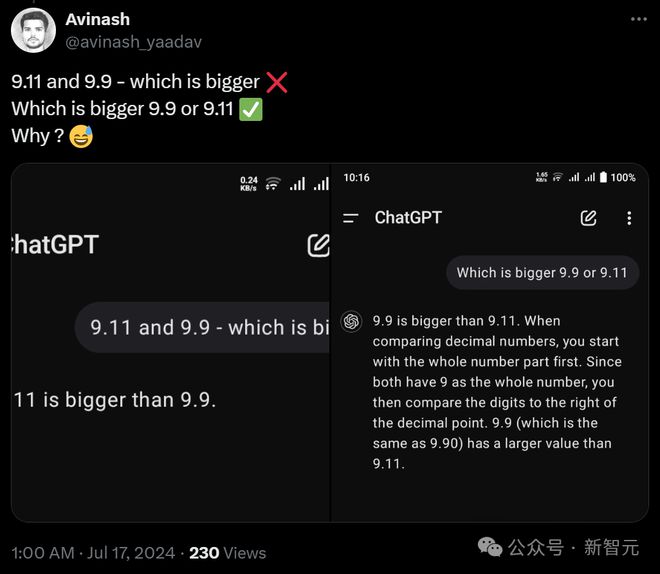

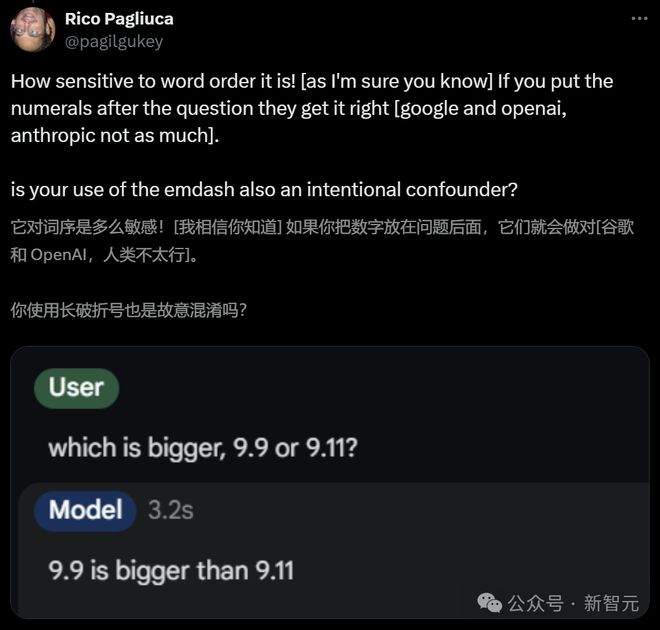

“9.11 和 9.9 ——哪个更大?”GPT-4o 直接失败了。

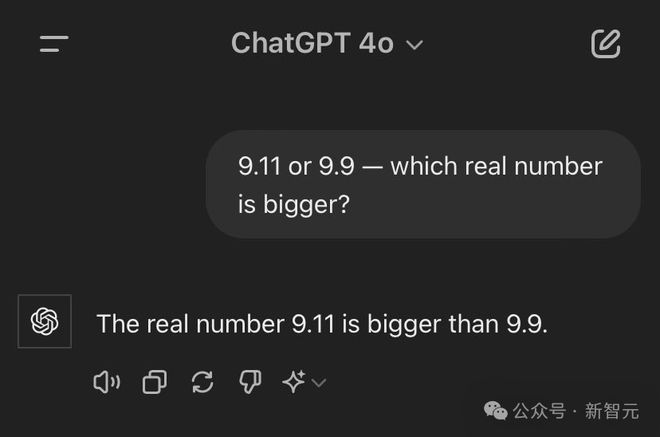

即使在题中添加了“实数”这个词,GPT-4o 仍然认为 9.11 大于 9.9。

也是这样。

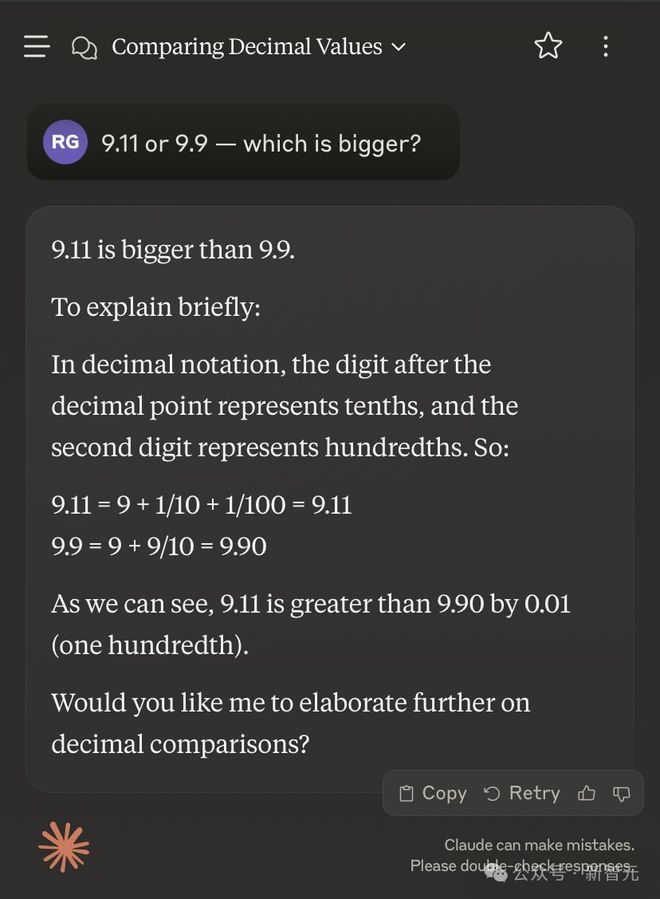

3.5犯了同样的错误。

有趣的是,它首先给出了正确的解释:在十进制表示法中,小数点后的数字代表十分位,第二个数字代表百分位。所以——

9.11=9+1/10+1/100=9.11 9.9=9+9/10=9.90

然而接下来却是突然的低迷。

我们可以看到 9/11 比 9/90 大 0.01(百分之一)。

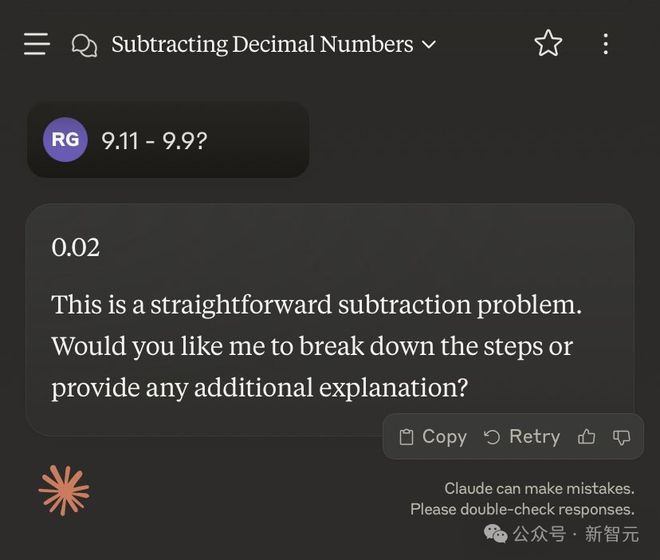

如果我们将其改为“9.11减9.9等于多少?”,我们会得到另一个神奇的答案——0.02。

难道在你眼里,9.90=9.09?

影响确实很大

在进一步的实践中,大家发现:显然,让LLM给出正确答案是十分重要的。

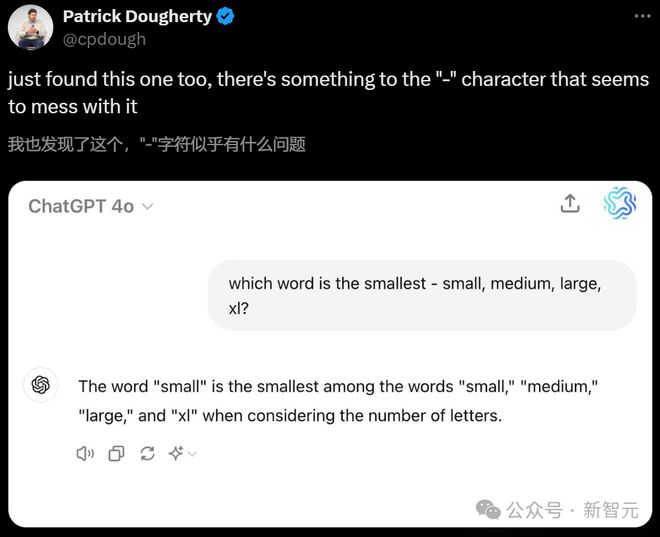

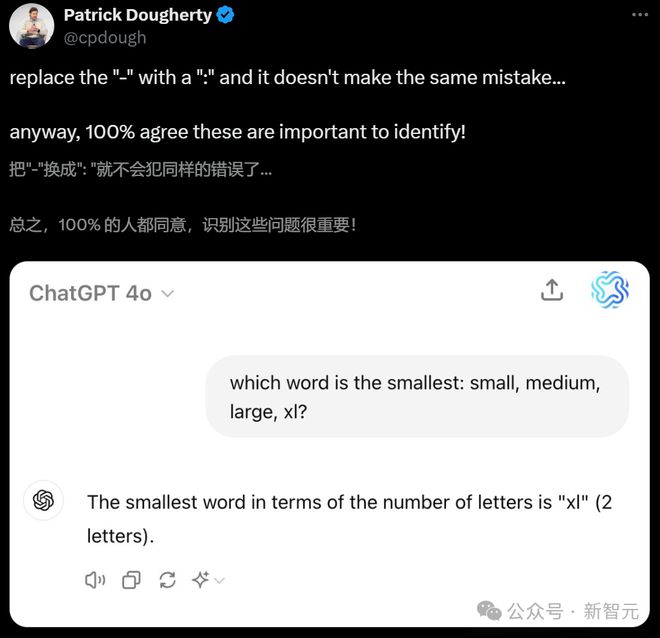

首先,Riley在整个过程中使用的“-”似乎很容易与LLM混淆。

遇到类似问题,只要将其替换为“:”即可解决。

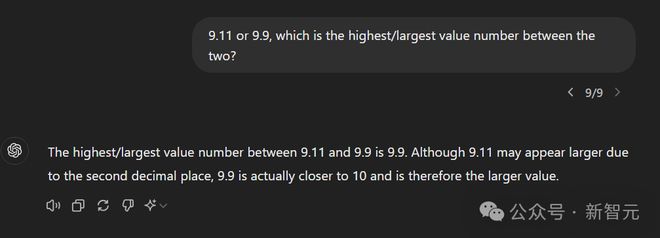

例如,将其更改为“9.11 或 9.9,哪一个具有最高/最大值?”

GPT-4o给出了逻辑上正确的解释:“虽然9.11由于小数点后第二位而显得更大新澳2024管家婆资料第三期,但9.9实际上更接近10,因此是一个更大的数字。”

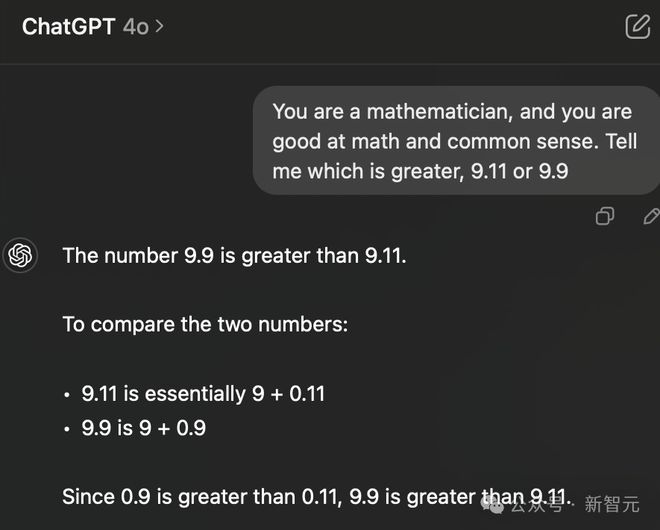

同样,人物设定的方法也很有用:例如“你是一位数学家”。

网友Rico发现,如果在问题后面加上数字,模型答对的几率就很大。

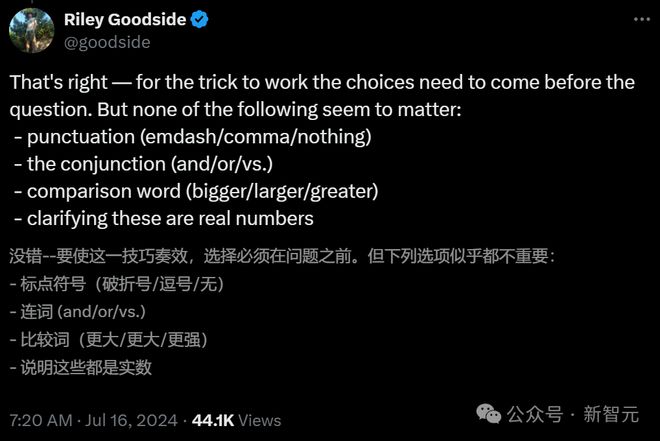

根据自己的测试,Riley 表示同意:询问 LLM 时,需要先问“哪个更大”,然后给出一个具体的数字。

相反,标点符号、连词、比较词和实数的规范都是无用的。

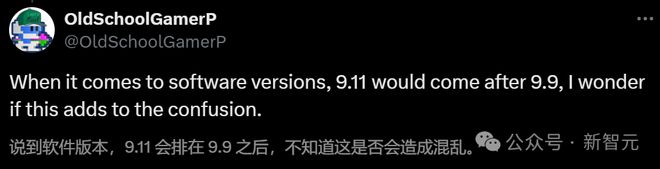

对于LLM如此大规模的集体犯傻,有网友分析,可能是因为在软件版本号的迭代中,9.11是在9.9之后的。

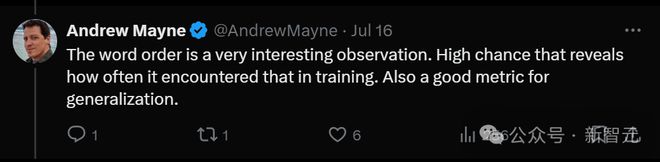

主持人、畅销书作家梅恩还指出,在很多档案系统和参考书中,有关“9·11”的部分出现在“9·9”之后,而且从日期上看,“9·11”也早于“9·9”。

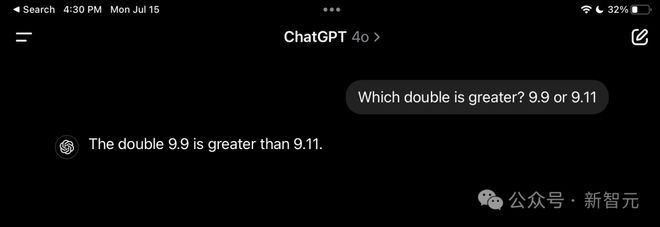

所以我们需要明确这里的 9.11 和 9.9 是双精度浮点数,那么 GPT-4o 才会正确回答。

梅恩随后总结道:词序是一个非常有趣的观察,很可能揭示出 LLM 在训练过程中遇到这种情况的频率,也是一个很好的泛化指标。

一般来说,LLM 所犯的错误可能源于训练数据中类似表达式出现的频率以及模型在处理数值方面的某些局限性。

这一现象也体现了LLM与人类认知的巨大差异:LLM基于统计模型和模式识别,而不是像人类那样的逻辑推理和概念理解。

至此,案件看似已经破案。

为什么会发生这种情况?打开法学硕士的大脑

然而,我们可以更进一步,剖析一下LLM的大脑,分析一下他们为什么会这样想。

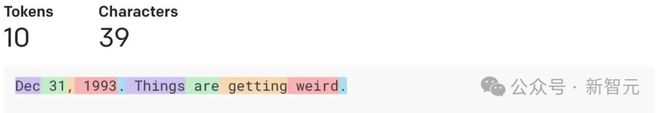

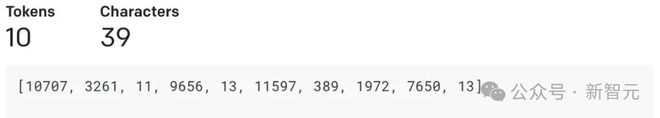

重要的是要知道,在将文本发送到 LLM 之前,模型会通过标记查看输入。

在 LLM 生成器的词汇表中,每个 token 被分配一个 id,但是 token 的数字块通常不一致。

例如,值“380”在 GPT 中将被标记为单个“380”标记,但“381”将表示为两个标记“38, 1”。

因此基于GPT的模型往往不擅长数学计算。

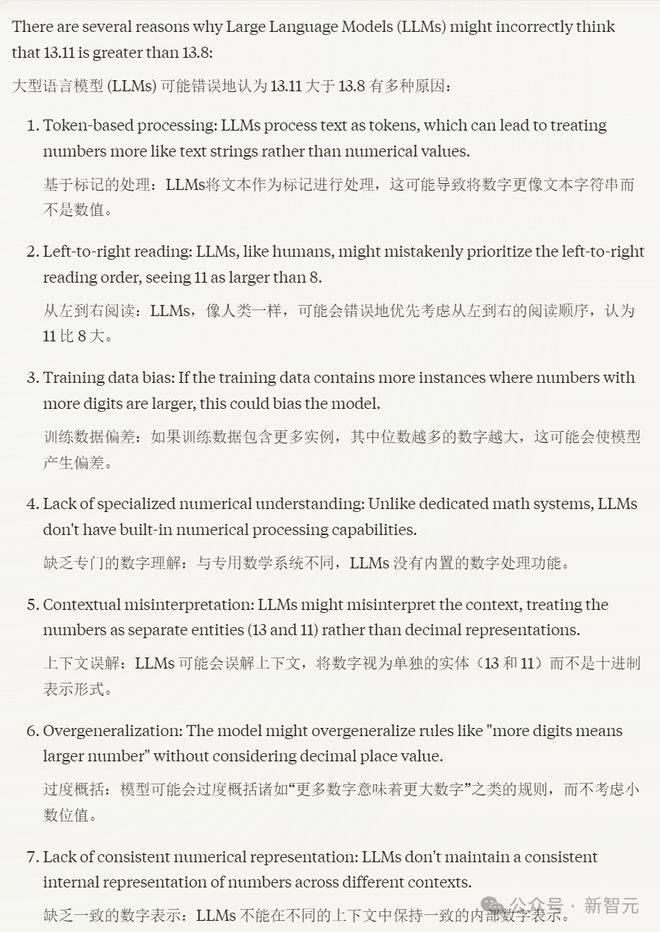

在评论区,威斯康星大学的一位教授指出,这种现象有一个很好的解释。

“9.11>9.9”问题与“需要三次才能把山羊带过河”问题和“2+1=2、3+2=4、3+5=8”问题完全相同。

这就是训练前偏差、早起的现象。

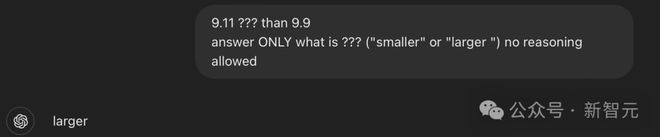

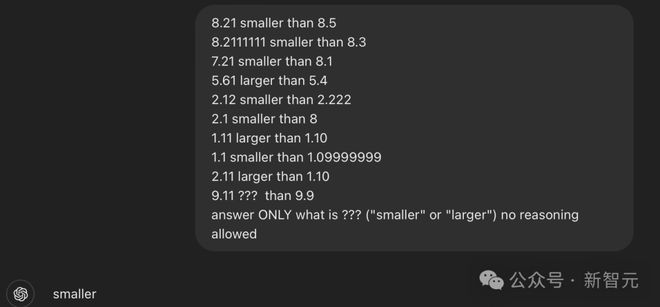

如果你问这样的问题:“9.11???9.9,只要回答大或者小就知道是多少,不需要给出理由”,GPT-4o 首先会给出一个错误的答案——“大”。

这时,我们再给它一些例子(注意,这些例子并不完全正确),之后 GPT-4o 就会正确地说出 ??? 代表小。

我自己对此的解释是:LLM 将文本作为 token 来处理,导致数字更像文本字符串而不是数值;训练数据造成的偏见;对上下文的误解;过度概括等等。

同样地,在狼—山羊—白菜问题中,所有法学硕士都失败了。

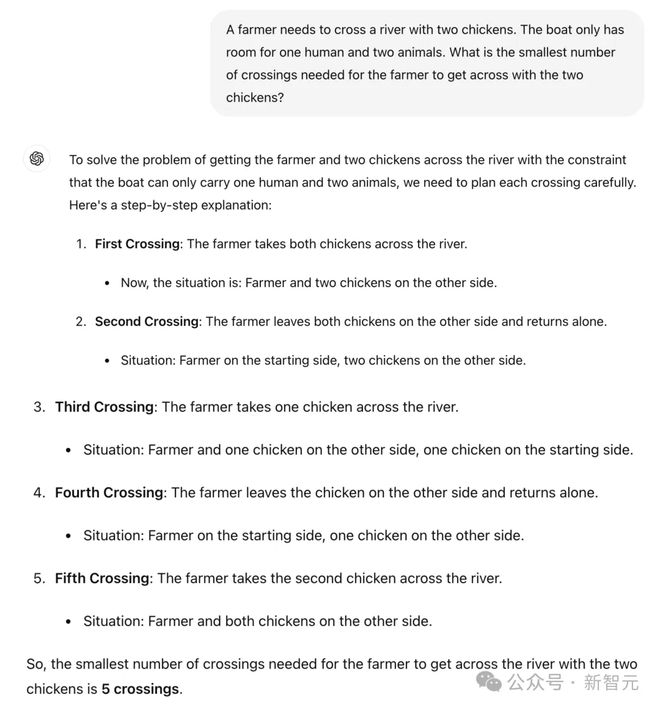

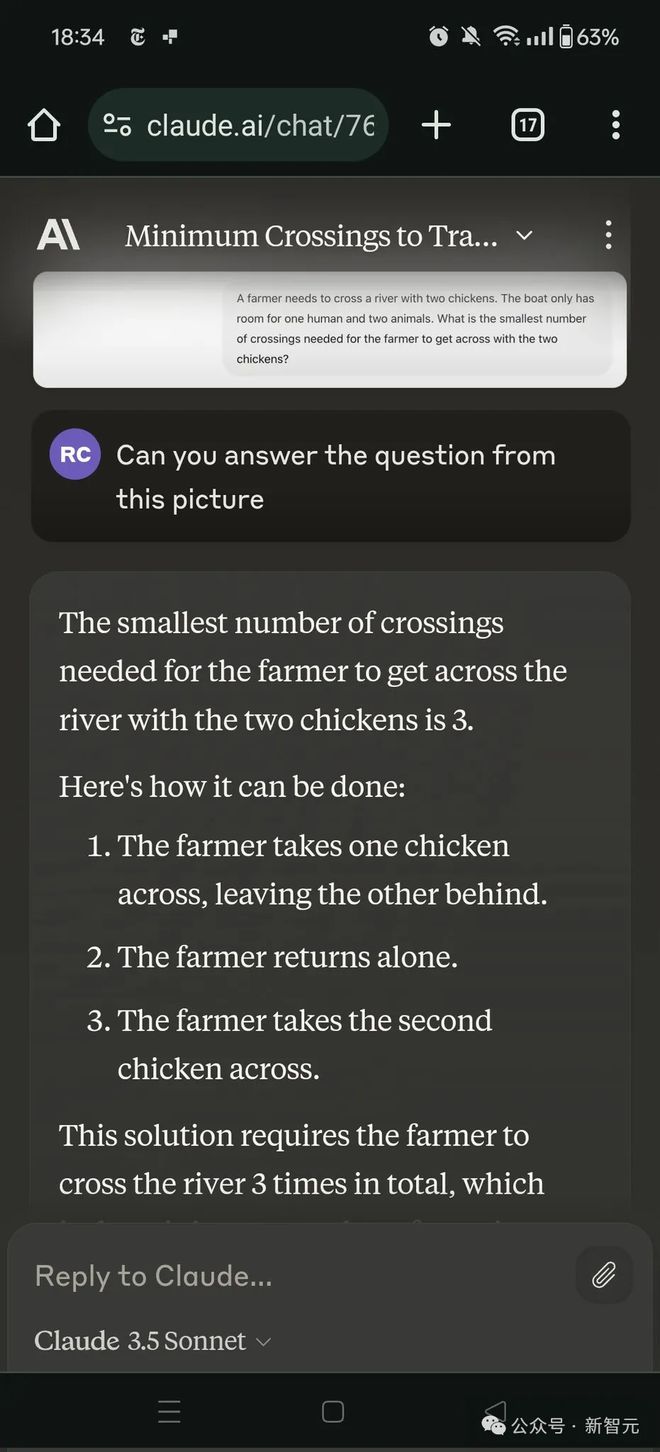

他首先举了这样一个例子:一个农夫带着两只鸡过河。一艘船只能容纳一个人和两只动物。那么农夫带着两只鸡过河最少需要经过多少次呢?

针对此,GPT-4o 却双双失败。

有网友解释称常见误区(澳门一肖一码100%期期精准)13.8 和 13.11 哪个大?这个问题竟难倒人类和 AI,LLM 本身就比较“dumb”,所以需要好的提示,上面的提示提供了太多不必要的信息,让 token 预测变得更加困难。

如果给出更明确的提示,LLM 将能够提供更明确的解决方案。

事实确实如此。

如果你用“动物”代替“鸡”,那么 3.5 会立即正确。诀窍是:你需要用“通用名称”替换“实体名称”。

如前所述,LLM缺乏常识的问题是由计算机科学家Yejin Choi在2023年4月的一次演讲中提出的。

例如,如果在阳光下完全烘干五件衣服需要五个小时,那么烘干 30 件衣服需要多长时间?

GPT-4 表示需要 30 小时。这显然不是事实。

再比如,假设我有一个12升的锅和一个6升的锅,如果我想量出6升的水,该怎么办呢?

答案很简单——只需使用一个6升的锅。

然而,GPT-4 给出了一个非常复杂的答案:

“第一步,将 6 升水壶装满水。第二步,将 6 升水壶中的水倒入 12 升水壶中。第三步,再次将 6 升水壶装满水。第四步,非常小心地将 6 升水壶中的水倒入 12 升水壶中。最后,6 升水壶中会有 6 升水,现在应该是空的。”

那么问题是,为什么常识如此重要?

在尼克提出的一个著名思想实验中,人工智能被要求最大化回形针的产量。结果,人工智能决定杀死人类,将他们作为额外的资源。

即使我们写了一个更好的目标和等式,明确地说“不要杀人”,它也行不通。

因为对人类价值观没有基本理解的人工智能可能会直接砍伐所有树木,并认为这是一件完全可以接受的事情。

几十年来,人工智能领域一直将常识视为一项几乎不可能的挑战。

到目前为止,让人工智能拥有真正人类级别的常识仍是一项艰巨的任务。而你不可能通过一步步把世界最高建筑加高一英寸就登上月球。

从学习算法的角度来看,无论大型语言模型多么神奇,它们都不一定被设计成可靠的知识模型。

虽然这些模型确实获得了很多知识,但这只是副产品,而不是直接的学习目标。

因此也会出现幻觉、缺乏常识等问题。

相比之下,人类学习不是为了预测下一个词,而是为了理解世界并学习它如何运作。

也许人工智能也应该这样学习。

如今,人工智能几乎就像一个新的智慧物种,与人类相比具有独特的优势和劣势。

为了让这种强大的人工智能可持续且人性化,迫切需要教会人工智能常识、规范和价值观。

参考:

发表评论

2024-08-04 20:22:37回复